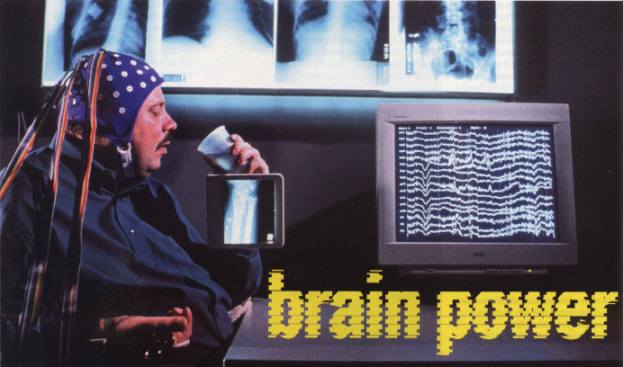

Rys. 1 Elektrody odczytujące sygnały z mózgu i komputer, które je przetwarza.

Wkrótce możliwe będzie pisanie na komputerze oraz wydawanie poleceń bez użycia jakichkolwiek zewnętrznych urządzeń pośredniczących. Naukowcy na całym świecie pracują nad tym problemem. Na przykład, Wspólne Centrum Naukowe Komisji Europejskiej rozwinęło "adaptacyjny interfejs mózgu", kask oraz program komputerowy, którego zadaniem było umożliwienie sterowania urządzeniami wykorzystując komendy wydawane przez mózg. Urząd Badań w Farnborough taką samą technikę wykorzystywał do sterowanie myśliwcem w czasie lotu. Tak naprawdę, badania nad tym projektem odbywały się w laboratorium profesora Miguela Nicolelisa, w Centrum Medycznym na Uniwersytecie Duke w Północnej Karolinie. Wytrenował on dwie małpy do sterowania ramieniem robota poprzez sygnały mózgu (rys. 2). Nicolelis zaimplantował elektrody w mózgu małp, gdzie tworzą się informacje o ruchu. Kiedy mózg instruuje ciało do wykonania ruchu, to pojawia się sygnał elektryczny zanim jakakolwiek akcja zostanie wykonana.